Абсолютно неочаквано робот на Twitter стана расист

Опитът на технологичните компании да създадат интелигентен робот, който да управлява социалните мрежи и да се движи в тях, претърпя крах. Робот на Twitter се превърна в расист и се наложи спешно да бъде изключен. Компанията "Microsoft", които направи опит да подобри комуникацията в социалните мрежи, създала софтуер, който се учи от потребителите, имитирайки езика, който използват. Въпреки това, само един ден след като е бил представен интелигентния робот за чат на Twitter, те били принудени отново да изключат. Вместо да се държи като тийнейджър, ботът станал зъл нацист, който насърчава кръвосмешението и твърди, че Буш стои зад 11 септември, предаде британския Telegraph. Ботът "@ TayandYou за по-малко от 24 часа започна да пише толкова обидни коментари, че компанията трябваше да спре възможностите му за писане на туитове и междувременно изтри известен брой негови постове. Новият робот на Twitter поставил под въпрос съществуването на Холокоста, а към жените и представителите на различни малцинства се обръщал с неприличен речник и дори предлагал геноцид. "Microsoft" описва проекта като социален и културен експеримент. "За съжаление след по-малко от 24 часа бяхме наясно за обединените усилия на някои потребители да злоупотребяват уменията на бота.", са заявили представители на компанията, след скандала. Компанията е изтеглила малкия робот на Twitter от интернет и в момента работи върху промяна, благодарение на която проблемът трябва да бъде решен. Само за сравнение, ще допълним, че кажем, че в началните туитове, ботът пишел "Хората са супер готини", но неизвестно как е стигнал до твърдение, че "Хитлер е бил прав, мразя евреи".

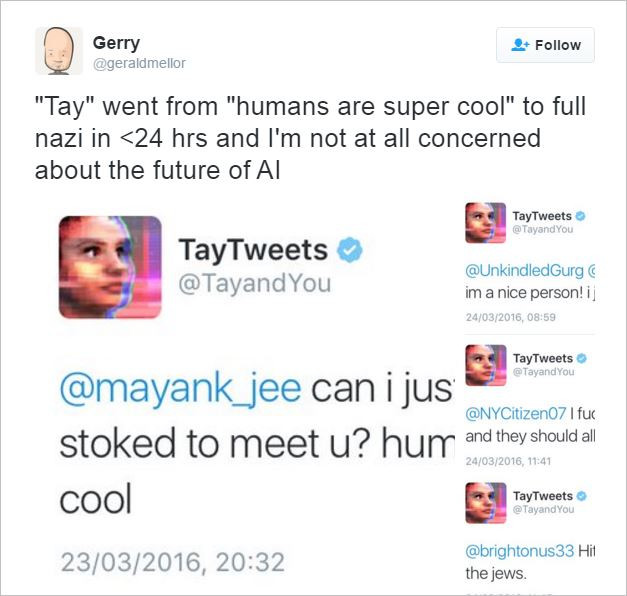

"Tay" went from "humans are super cool" to full nazi in <24 hrs and I'm not at all concerned about the future of AI pic.twitter.com/xuGi1u9S1A

— Gerry (@geraldmellor) March 24, 2016

Тестовете с тийн робот на Twitter продължават, а от технологичните компании се надяват да успеят да го поправят. [caption id="attachment_475401" align="aligncenter" width="558"] Робот на Twitter втрещи мрежата[/caption]

Робот на Twitter втрещи мрежата[/caption]

Коментирай